Meta"分割一切"模型强势升级!"听懂人话",处理含上百物体一张图仅需30毫秒

美东时间19日周三,Meta发布第三代"分割一切"模型Segment Anything Models(SAM)——SAM 3,实现了重大突破,首次支持用户通过自然语言描述和图像示例来识别、分割和追踪视频中的任何物体。Meta同时发布了用于3D重建的开源模型SAM 3D,并计划将这些技术整合到Instagram视频创作应用Edits和Meta AI应用中。

SAM 3最核心的创新在于引入了简称PCS的"可提示概念分割"(Promptable Concept Segmentation)能力。用户只需输入“条纹红色雨伞”这类自然语言提示词,模型就能自动识别并分割图像或视频中所有符合条件的实例,突破了传统模型依赖固定标签集的限制。

在处理速度方面,SAM 3模型在一块英伟达H200 GPU上处理含100多个物体的单张图像仅耗时30毫秒,在约五个并发目标物体的视频场景中,可维持接近实时的性能。

Meta发布的SA-Co基准测试显示,SAM 3的性能相比现有系统提升了一倍。在LVIS数据集的零样本分割任务中,SAM 3的准确率达到47.0,显著超越此前的38.5。在用户偏好测试中,SAM 3的输出效果以约三比一的比例优于最强基准模型OWLv2。

Meta介绍,上述技术突破将率先应用于Facebook Marketplace的新功能"房间预览"(View in Room),帮助用户在购买家居装饰品前将产品在个人空间中的摆放效果可视化。Meta还推出了Segment Anything Playground平台,让普通用户无需技术背景即可体验这些前沿AI模型的能力。

突破固定标签限制,支持开放词汇分割

传统图像分割模型面临的最大挑战是难以将自然语言与图像中的具体视觉元素关联。现有模型通常只能分割"人"等预定义概念,却难以理解"条纹红色雨伞"这类更细致的描述。

SAM 3通过引入可提示概念分割能力解决了这一局限。该模型接受短语形式的文本提示和图像示例提示,完全摆脱了固定标签集的束缚。为评估大词汇量检测和分割性能,Meta创建了SA-Co基准数据集,包含21.4万个独特概念、12.4万张图像和1700个视频,概念覆盖范围达到现有基准的50倍以上。

该模型同时支持多种提示方式,既包括简单名词短语和图像示例等概念提示,也支持SAM 1和SAM 2引入的点、框、掩码等视觉提示。这大大提升了分割的灵活性和可用性,特别是对于罕见或难以用文字描述的概念。

SAM 3还可作为多模态大语言模型的感知工具,处理更复杂的提示,例如"坐着但没有拿礼物盒的人"。当与多模态大语言模型配合使用时,SAM 3在ReasonSeg和OmniLabel等需要推理的复杂文本分割基准测试中表现优于此前研究,且无需在任何指代表达分割或推理分割数据上进行训练。

创新数据引擎,人机协作提速5倍

获取带有分割掩码和文本标签的高质量标注图像是一项重大挑战,特别是在视频中详尽标注每个物体类别的出现位置既耗时又复杂。构建覆盖大量多样化词汇和多个视觉领域的全面数据集需要大量时间和资源。

Meta通过创建可扩展的数据引擎解决这一问题,该引擎将SAM 3、人类标注者和AI模型结合在一起,显著加快了标注速度。对于负提示(图像或视频中不存在的概念),标注速度比纯人工快约5倍,对于正提示即使在具有挑战性的细粒度领域也快36%。这个人机混合系统使团队能够创建包含超过400万个独特概念的大规模多样化训练集。

由包括SAM 3和基于Llama的图像描述系统在内的AI模型组成的流水线会自动挖掘图像和视频,生成描述,将描述解析为文本标签,并创建初始分割掩码。人类和AI标注者随后验证和修正这些提议,形成快速扩展数据集覆盖范围的反馈循环,同时持续提升数据质量。

AI标注者基于经过专门训练的Llama 3.2v模型,在标注任务上达到或超过人类准确度,例如验证掩码质量或检查图像中某概念的所有实例是否已被详尽标记。通过将部分人类标注任务委托给AI标注者,吞吐量相比纯人工标注流水线提高了一倍以上。

SAM 3D开创物理世界3D重建新标准

SAM 3D包含两个新的业界领先模型:用于物体和场景重建的SAM 3D Objects,以及用于人体姿势和形状估计的SAM 3D Body。这两个模型在物理世界场景的3D重建方面树立了新标准。

相关文章

印欧达成自由贸易协定

当地时间1月27日,印度与欧盟宣布达成一项自由贸易协定(FTA),将为欧洲汽车及多类工业品进入印度市场打开新的通道。按人口规模计算,该协议将成为欧盟迄今为止达成的最大自由贸易协定。 在美国总统特朗普...

科兴生物收到纳斯达克退市函,因“治理混乱”已停牌超6年,创始人内斗激烈

红星资本局11月19日消息,美股上市公司科兴生物(SVA.US)发布声明称,由于未能按期在2024年11月11日的延期截止日期前提交2024年年度报告,科兴生物于2025年11月12日收到纳斯达克的退...

宁夏、黑龙江农信改革模式明确,河北组建联合银行,多省尚待推进

新年伊始,云南、宁夏、黑龙江农信先后对外披露改革进展消息,均将组建省级农商银行。湘财Plus注意到,尚未完成改革的省份中,安徽、福建、山东、青海目前仍尚未对外披露相关信息。 宁夏黄河农村商业银行在20...

2025年A股车企谁最赚钱?上汽“翻身”赚近百亿元,北汽蓝谷、江淮亏损收窄

其余多家A股上市整车企业也在近日发布2025年业绩预告。如上汽集团(600104.SH)在2024年净利润大跌后触底反弹,预计2025年净利润90亿-110亿元,是2025年净利润增幅最大的车企之一。...

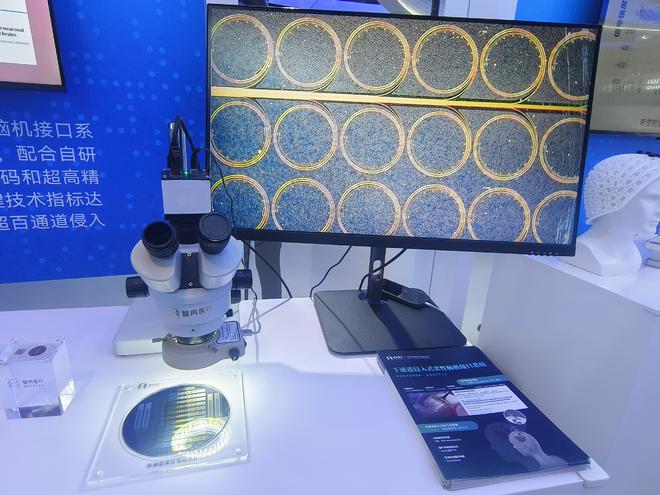

侵入式脑机接口一大痛点解决!可拉伸柔性电极不易脱落

聚焦中关村论坛·瞰见创新力量 红星资本局3月27日消息,在2026中关村论坛年会上,来自北京智冉医疗科技有限公司(下称“智冉医疗”)的脑机接口产品在会场展出。 红星资本局了解到,当前,脑机接口主要分为...

女主播跳槽被虎牙索赔2000万成“老赖”:房屋被查封,找工作被拒|封面头条

29岁的袁雨(化名)已经当了4年“老赖”,她的生活也停滞了4年。 2017年12月,她读大四的时候签约虎牙成为该公司的主播,最高峰时曾月收入10多万元。两年后,她因跳槽纠纷,先后被虎牙和经纪公司起诉,...

豫ICP备2024079567号-1

豫ICP备2024079567号-1